Ngày 3/1, Trung tâm xử lý tin giả, thông tin xấu độc Việt Nam cho biết đã nhận được phản ánh của ông Hồ Huy, chủ tịch Tập đoàn Mai Linh, về việc bị người khác sử dụng công nghệ Deepfake cắt ghép, phát tán các hình ảnh nhạy cảm của ông trên mạng xã hội.

|

| Chủ tịch Tập đoàn Mai Linh lên tiếng về hình ảnh bị cắt ghép trên các trang mạng xã hội |

>> Trả 5.000 USD để Facebook lan truyền video deepfake lừa đảo đầu tư

Cụ thể, đại diện Công Ty Cổ Phần Tập Đoàn Mai Linh cho biết trước đó, công ty đã nhận được thông tin một lãnh đạo của công ty bị cắt ghép hình ảnh với mục đích bôi nhọ uy tín. Hiện nay, công ty khẳng định những thông tin đang đồn thổi là tin giả, để câu view, bôi nhọ hình ảnh của công ty.

Phía Công ty có nhận được những cuộc gọi tống tiền, thông báo nếu không gửi tiền sẽ tạo những trend tiktok để tiếp tục bôi nhọ. Công ty Cổ phần Tập đoàn Mai Linh đã gửi đơn tới phòng An ninh mạng và phòng, chống tội phạm sử dụng công nghệ cao (PA05) để xử lý.

Theo ông Huy, mục đích hành vi trên nhằm bôi nhọ danh dự, nhân phẩm và uy tín cá nhân của ông, cũng như gây ảnh hưởng lớn đến hoạt động kinh doanh của Tập đoàn Mai Linh.

Trung tâm xử lý tin giả, thông tin xấu độc Việt Nam cho biết đã chuyển các cơ quan chức năng xem xét, xử lý theo quy định của pháp luật.

Trung tâm cũng lên tiếng cảnh báo một số thủ đoạn lừa đảo phổ biến bằng Deepfake đang diễn ra tại Việt Nam để lừa đảo tài chính, phá hoại uy tín,…

Khái quát chung về công nghệ Deepfake AI

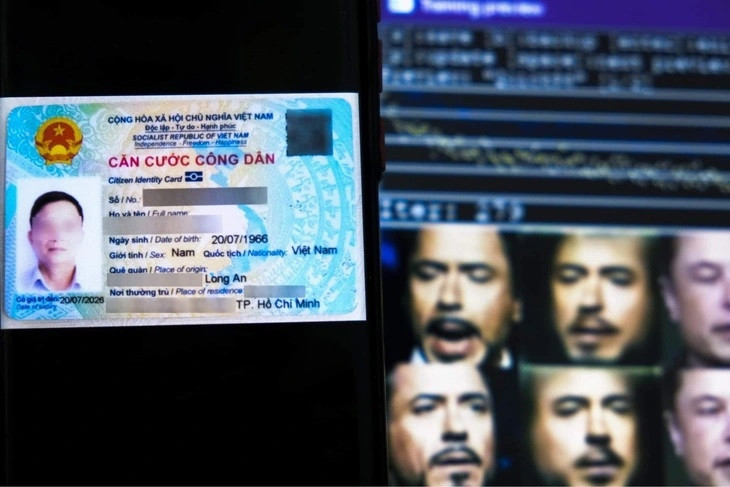

Công nghệ Deepfake được xây dựng trên nền tảng machine learning mã nguồn mở của Google. Deepfake sẽ quét video và ảnh chân dung của một người sau đó hợp nhất với video riêng biệt nhờ AI và thay thế các chi tiết trên gương mặt như mắt, miệng, mũi với chuyển động gương mặt, giọng nói như thật. Càng có nhiều hình ảnh gốc thì AI càng có nhiều dữ liệu để thực hiện. Deepfake có thể gán khuôn mặt của người này sang người khác trong video với độ chân thực đến kinh ngạc. Trong deepfake AI, các thuật toán học sâu tự dạy cách giải quyết vấn đề với tập dữ liệu lớn, được sử dụng để hoán đổi khuôn mặt trong video, hình ảnh và nội dung kỹ thuật số khác để làm cho giả mạo có vẻ như thật.

>> Video deepfake ngày càng tinh vi và giống thật

Với việc công nghệ doppelganger giúp tạo ra một bản sao giống hệt chủ thể ngày càng phát triển với độ chân thực video cải tiến thì người dân khó có thể phân biệt được đâu là người thực đang nói trước ống kính và đâu là video AI.

Cách thức hoạt động của Deepfake liên quan chặt chẽ với trí tuệ nhân tạo. Từ đó, hình ảnh khuôn mặt của một số người nhất định (tạm gọi là người A) với chất lượng cao được thay thế hoàn toàn bằng khuôn mặt của một người khác (người B). Ảnh nén của A được đưa vào bộ giải mã của B. Bộ giải mã sau đó tái tạo lại khuôn mặt của người B với biểu cảm và hướng khuôn mặt của người A. Quá trình này được thực hiện liên tục, chi tiết đến khi cho ra sản phẩm “thật” nhất.

|

| Công nghệ Deepfake |

Thủ đoạn của các đối tượng lợi dụng deepfake

Lợi dụng Deepfake các đối tượng lừa đảo có thể làm giả cuộc gọi video nhằm chiếm đoạt tài sản. Cụ thể, thông qua mạng internet, các đối tượng đã thu thập hình ảnh, giọng nói của người dùng trên mạng xã hội (facebook, zalo...). Deepfake có thể ảnh động, video giả mạo người dùng đang nói chuyện trực tuyến với cùng khuôn mặt, giọng nói và cách xưng hô.

Với công nghệ Deepfake, video giả mạo có độ chính xác rất cao, rất khó để phân biệt thật giả. Tuy nhiên, video do đối tượng tạo sẵn thường có nội dung chung chung, không phù hợp hoàn toàn với ngữ cảnh thực tế giao tiếp với nạn nhân, có thể khiến nạn nhân nghi ngờ, phát hiện. Để che lấp khuyết điểm này, các đối tượng thường tạo ra những video với âm thanh khó nghe, hình ảnh không rõ nét giống cuộc gọi video có tín hiệu chập chờn do khu vực phủ sóng di động/wifi yếu để nạn nhân khó phân biệt thật giả. Nếu nạn nhân cẩn thận gọi video lại để kiểm chứng, chúng sẽ không nhận cuộc gọi hoặc sử dụng phần mềm cắt ghép hình ảnh, video để đánh lừa.

Một số cách phòng tránh hiệu quả lừa đảo lợi dụng Deepfake

Mỗi người đều luôn cần tỉnh táo đề phòng khi sử dụng mạng xã hội và xác minh thật kỹ đối với thông tin liên quan đến tài chính, các đường link lạ và thiết lập cơ chế bảo mật thông tin cá nhân.

Bên cạnh đó, để phòng tránh video, cuộc gọi Deepfake người dùng nên lưu ý một vài đặc điểm sau:

Khuôn mặt nhân vật thiếu tính cảm xúc và khá “đơ” khi nói.

Tư thế của nhân vật trông lúng túng, không tự nhiên, hoặc là hướng đầu và cơ thể của nhân vật trong video không nhất quán với nhau; Màu da bất thường, ánh sáng kỳ lạ và bóng đổ không đúng vị trí;

Âm thanh sẽ không đồng nhất với hình ảnh, có nhiều tiếng ồn bị lạc vào clip hoặc clip không có âm thanh; Tài khoản chuyển tiền không phải của người đang thực hiện cuộc gọi...

>> Nikon, Sony và Canon ứng dụng công nghệ mới chống deepfake