Microsoft 'chơi lớn' mua gần nửa triệu chip Nvidia

Nhà tài trợ lớn nhất của OpenAI đã mua gần nửa triệu GPU trong năm nay, nhằm nỗ lực vượt lên trong cuộc đua toàn cầu xây dựng hệ thống trí tuệ nhân tạo.

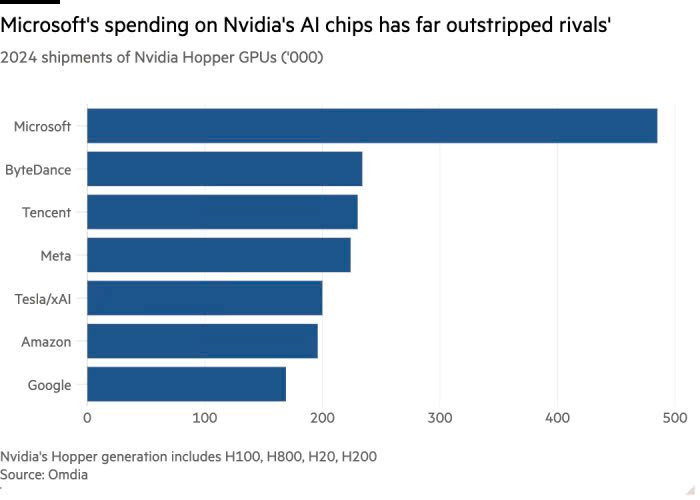

Trong năm nay, Microsoft đã mua gấp đôi số lượng chip flagship của Nvidia so với bất kỳ đối thủ lớn nào ở Mỹ và Trung Quốc, khi nhà đầu tư lớn nhất của OpenAI tăng tốc đầu tư vào cơ sở hạ tầng trí tuệ nhân tạo (AI).

Theo ước tính của Omdia, một công ty tư vấn công nghệ, Microsoft đã mua 485.000 chip "Hopper" của Nvidia, vượt xa các khách hàng lớn khác như Meta (224.000 chip), cũng như các đối thủ điện toán đám mây là Amazon và Google.

Với nhu cầu vượt về các bộ vi xử lý đồ họa tiên tiến nhất của Nvidia vượt quá nguồn cung trong hai năm qua, kho chip của Microsoft đã mang lại lợi thế quan trọng trong cuộc đua phát triển thế hệ AI tiếp theo.

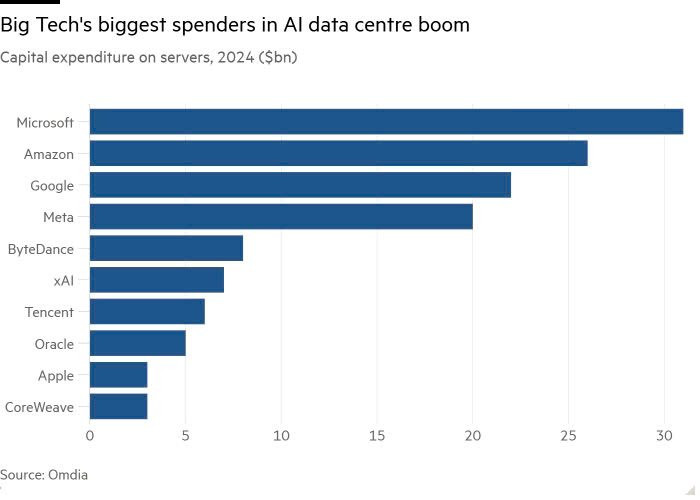

Năm nay, các công ty công nghệ đã chi hàng chục tỷ USD cho các trung tâm dữ liệu sử dụng chip mới nhất của Nvidia - những sản phẩm trở thành hàng hóa nóng nhất tại Silicon Valley kể từ khi ChatGPT ra đời.

Hạ tầng đám mây Azure của Microsoft đã được sử dụng để huấn luyện mô hình mới nhất của OpenAI, trong bối cảnh cuộc cạnh tranh gay gắt giữa các ông lớn công nghệ và các startup như Anthropic và xAI của Elon Musk.

ByteDance và Tencent nổi lên là hai trong số những khách hàng lớn nhất của Nvidia, bất chấp các hạn chế của Chính phủ Mỹ đối với khả năng của các chip AI Mỹ được bán tại Trung Quốc. Omdia ước tính ByteDance và Tencent mỗi công ty đã đặt hàng khoảng 230.000 chip của Nvidia trong năm nay, bao gồm cả mẫu H20 được điều chỉnh để phù hợp với quy định xuất khẩu của Mỹ.

Trong khi đó, Amazon và Google đang tăng cường phát triển các chip AI tùy chỉnh, với việc mua lần lượt 196.000 và 169.000 chip Hopper.

Ước tính của Omdia dựa trên các phân tích về chi tiêu vốn công khai của các công ty, lượng giao hàng và thông tin từ chuỗi cung ứng.

Giá trị vốn hóa của Nvidia, hiện đang bắt đầu triển khai thế hệ kế nhiệm Hopper là Blackwell, đã tăng vọt lên hơn 3 nghìn tỷ USD trong năm nay khi các công ty công nghệ lớn gấp rút lắp ráp các cụm GPU ngày càng lớn.

Tuy nhiên, sự tăng trưởng của cổ phiếu Nvidia đã có dấu hiệu chậm lại do lo ngại về tăng trưởng, sự cạnh tranh từ các chip AI tùy chỉnh và khả năng gián đoạn hoạt động kinh doanh tại Trung Quốc khi chính quyền Donald Trump lên nắm quyền tại Mỹ.

Microsoft, với khoản đầu tư 13 tỷ USD vào OpenAI, đang dẫn đầu trong việc xây dựng cơ sở hạ tầng trung tâm dữ liệu, phục vụ cả các dịch vụ AI riêng như Copilot và nhu cầu thuê của khách hàng thông qua Azure. Đơn đặt hàng chip Nvidia của Microsoft năm nay gấp 3 lần so với năm 2023, cho thấy sự cam kết mạnh mẽ của công ty với công nghệ AI.

Alistair Speirs, Giám đốc cấp cao của Azure Global Infrastructure, nhấn mạnh tầm quan trọng của việc lập kế hoạch dài hạn và dự báo xu hướng tăng trưởng trong các dự án hạ tầng trung tâm dữ liệu phức tạp.

Theo Omdia, các công ty công nghệ dự kiến sẽ chi 229 tỷ USD cho máy chủ trong năm 2024, dẫn đầu là Microsoft với 31 tỷ USD chi tiêu vốn và Amazon với 26 tỷ USD. 10 khách hàng hàng đầu trong hạ tầng trung tâm dữ liệu, hiện bao gồm những công ty mới như xAI và CoreWeave, chiếm 60% đầu tư toàn cầu vào sức mạnh điện toán.

Vlad Galabov, Giám đốc nghiên cứu đám mây và trung tâm dữ liệu tại Omdia, cho biết khoảng 43% chi tiêu cho máy chủ sẽ được dành cho Nvidia trong năm 2024. “GPU của Nvidia chiếm một phần lớn trong chi tiêu vốn của máy chủ”, ông nói. “Chúng ta gần chạm đỉnh”.

Mặc dù Nvidia vẫn chiếm ưu thế trong thị trường chip AI, đối thủ của họ tại Silicon Valley là AMD đang bắt đầu chiếm lĩnh thị trường. Meta đã mua 173.000 chip MI300 của AMD trong năm nay, trong khi Microsoft mua 96.000 chip, theo Omdia.

Các công ty công nghệ lớn cũng đang gia tăng việc sử dụng các chip AI của chính họ trong năm nay, trong nỗ lực giảm sự phụ thuộc vào Nvidia. Google, công ty đã phát triển các "đơn vị xử lý tensor" (TPUs) trong suốt một thập kỷ, và Meta, công ty đã ra mắt thế hệ chip Meta Training and Inference Accelerator đầu tiên vào năm ngoái, mỗi công ty đã triển khai khoảng 1,5 triệu chip của riêng mình.

Amazon, công ty đang đầu tư mạnh vào các chip Trainium và Inferentia cho khách hàng điện toán đám mây, đã triển khai khoảng 1,3 triệu chip trong năm nay. Amazon cho biết tháng này rằng họ dự định xây dựng một cụm mới sử dụng hàng trăm nghìn chip Trainium mới nhất cho Anthropic, đối thủ của OpenAI mà Amazon đã đầu tư 8 tỷ USD, để huấn luyện thế hệ mô hình AI tiếp theo.

Con số của Microsoft khiêm tốn hơn, với chỉ khoảng 200.000 chip Maia được cài đặt trong năm nay.

Speirs cho biết việc sử dụng chip của Nvidia vẫn yêu cầu Microsoft phải đầu tư lớn vào công nghệ của chính mình để cung cấp một dịch vụ "đặc biệt" cho khách hàng.

“Để xây dựng cơ sở hạ tầng AI, theo kinh nghiệm của chúng tôi, không chỉ là việc sở hữu chip tốt nhất, mà còn phải có các thành phần lưu trữ phù hợp, cơ sở hạ tầng phù hợp, lớp phần mềm phù hợp, lớp quản lý máy chủ phù hợp, sửa lỗi và tất cả các thành phần khác để xây dựng hệ thống đó", ông nói.

Theo FT

>> Muốn gia nhập đế chế bán dẫn Nvidia, ứng viên cần vượt qua những ‘cửa ải’ khó nhằn nào?

.png)